MIT இன் ஒரு முன்னோடியான ஆய்வு, பார்வை-மொழி மாதிரிகளில் (VLMs) ஒரு முக்கியமான குறைபாட்டை வெளிப்படுத்தியுள்ளது; இது மருத்துவம் மற்றும் பிற உயர் முக்கியத்துவம் கொண்ட சூழல்களில் அவற்றை பயன்படுத்துவதில் தீவிர விளைவுகளை ஏற்படுத்தக்கூடும்.

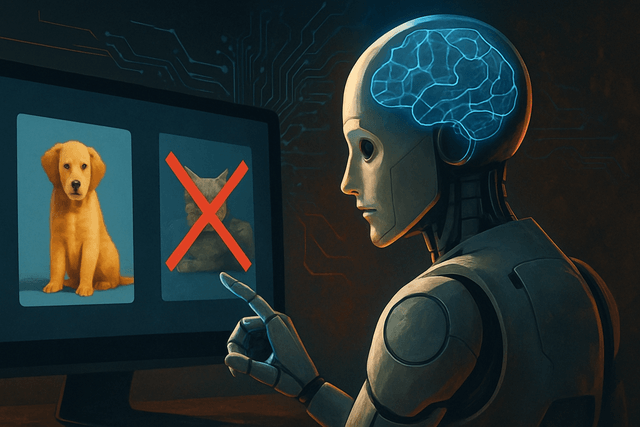

MIT ஆராய்ச்சியாளர்கள், VLMs மறுப்பு (negation) — 'இல்லை', 'இல்லை', 'இல்லை' போன்ற சொற்கள் எதைக் குறிக்கின்றன என்பதை — புரிந்துகொள்ள முடியாததால், உண்மையான சூழல்களில் தவறுகள் செய்ய அதிக வாய்ப்பு இருப்பதாக கண்டுபிடித்துள்ளனர். "இந்த மறுப்பு சொற்கள் மிக முக்கியமான தாக்கத்தை ஏற்படுத்தும்; நாம் இந்த மாதிரிகளை கண்காணிக்காமல் பயன்படுத்தினால், பேரழிவான விளைவுகளை சந்திக்க நேரிடும்," என்கிறார் MIT பட்டதாரி மாணவர் மற்றும் ஆய்வின் முதன்மை எழுத்தாளர் குமைல் அல்-ஹமூத்.

ஆராய்ச்சியாளர்கள் இந்த பிரச்சினையை மருத்துவ உதாரணம் மூலம் விளக்குகின்றனர்: ஒரு ரேடியாலஜிஸ்ட், ஒரு நோயாளியின் மார்புப் படம் (X-ray) பார்த்து, திசுக்களில் வீக்கம் இருப்பதை கவனிக்கிறார்; ஆனால் இதய பெரிதாகவில்லை என்பதை குறிப்பதாகக் கூறுகிறார். இந்த சூழலில், பார்வை-மொழி மாதிரிகள் இந்த நிலைமைகளை வேறுபடுத்த முடியாமல் தவறுவதாக ஆராய்ச்சியாளர்கள் கூறுகின்றனர். மாதிரி தவறாக இரண்டுமே உள்ளதாக அறிக்கையை அடையாளம் காணும் பட்சத்தில், நோயாளிக்கு இதய சம்பந்தப்பட்ட நோய் இருக்க வாய்ப்பு உள்ளது; ஆனால் இதய பெரிதாக இல்லையெனில், பல்வேறு காரணங்கள் இருக்கலாம்.

பட விளக்கங்களில் (image captions) மறுப்பை கண்டறியும் திறனை சோதித்தபோது, இந்த மாதிரிகள் சீரற்ற ஊகிப்பதைவிட சிறப்பாக செயல்படவில்லை என்று ஆராய்ச்சியாளர்கள் கண்டுபிடித்தனர். இதை அடிப்படையாகக் கொண்டு, மறுப்பு சொற்கள் கொண்ட விளக்கங்களுடன் கூடிய படங்களின் தரவுத்தொகுப்பை உருவாக்கினர். இந்த தரவுத்தொகுப்புடன் மாதிரியை மீண்டும் பயிற்சி செய்தபோது, குறிப்பிட்ட பொருட்கள் இல்லாத படங்களை கண்டறியும் திறன் மேம்பட்டது. மறுப்பு கொண்ட கேள்விகளுக்கான பன்மை தேர்வு பதில்களில் கூட துல்லியம் அதிகரித்தது. இருப்பினும், இந்த பிரச்சினையின் அடிப்படை காரணங்களை தீர்க்க மேலும் ஆராய்ச்சி தேவை என அவர்கள் எச்சரிக்கின்றனர்.

"'இல்லை', 'இல்லை' போன்ற சொற்களுக்கு மட்டும் இது நடக்கவில்லை. நீங்கள் மறுப்பு அல்லது விலக்கலை எப்படி வெளிப்படுத்தினாலும், மாதிரிகள் அதை முழுமையாக புறக்கணிக்கின்றன," என்கிறார் அல்-ஹமூத். அவர்கள் சோதித்த அனைத்து VLM-களிலும் இது ஒரே மாதிரியாக இருந்தது. இந்த பிரச்சினை இந்த மாதிரிகள் எப்படி பயிற்சி பெறுகின்றன என்பதிலிருந்து தோன்றுகிறது. "விளக்கங்கள் படங்களில் உள்ளதை மட்டுமே சொல்கின்றன — அவை நேர்மறை (positive) குறிச்சொற்கள். அதுவே முழு பிரச்சினை. யாரும் ஒரு நாய் வேலியை தாண்டி குதிக்கிறது என்ற படத்தைப் பார்த்து, 'ஒரு நாய் வேலியை தாண்டி குதிக்கிறது, ஹெலிகாப்டர்கள் இல்லை' என்று விளக்கம் எழுத மாட்டார்கள்," என்கிறார் மூத்த எழுத்தாளர் மார்சியே காசெமி. பட-விளக்கம் தரவுத்தொகுப்புகளில் மறுப்பு எடுத்துக்காட்டுகள் இல்லாததால், VLM-கள் அதை கற்றுக்கொள்ள முடியவில்லை.

"மூலதனமான மறுப்பு (negation) கூட சரியாக செயல்படவில்லை என்றால், நாம் இந்த பெரிய பார்வை/மொழி மாதிரிகளை தற்போது பயன்படுத்தும் பல வழிகளில் — தீவிரமான மதிப்பீடு இல்லாமல் — பயன்படுத்தக்கூடாது," என்கிறார் காசெமி, MIT இன் மின் பொறியியல் மற்றும் கணினி அறிவியல் துறையின் இணை பேராசிரியரும், மருத்துவ பொறியியல் அறிவியல் நிறுவன உறுப்பினரும் ஆவார். இந்த ஆய்வு, கணினி பார்வை மற்றும் வடிவமைப்பு மாநாட்டில் (Conference on Computer Vision and Pattern Recognition) வழங்கப்பட உள்ளது; இதில் MIT, OpenAI மற்றும் Oxford பல்கலைக்கழக ஆராய்ச்சியாளர்கள் பங்கேற்றுள்ளனர்.

இந்த கண்டுபிடிப்பு, பாதுகாப்பு கண்காணிப்பு மற்றும் மருத்துவம் போன்ற உயர் முக்கியத்துவம் வாய்ந்த துறைகளுக்கு முக்கியமான தாக்கத்தை ஏற்படுத்துகிறது. மறுப்பு சார்ந்த பணிகளில் பார்வை-மொழி மாதிரிகளை மதிப்பீடு செய்ய NegBench என்ற விரிவான அளவுகோலை உருவாக்கியுள்ள இந்த ஆராய்ச்சி, நுணுக்கமான மொழி புரிதல் கொண்ட வலுவான ஏஐ அமைப்புகளுக்கான முக்கிய முன்னேற்றமாகும்; இது மருத்துவக் கண்டறிதல் மற்றும் அர்த்தமுள்ள உள்ளடக்க தேடலில் முக்கிய பங்கு வகிக்கிறது.