Une équipe de chercheurs dirigée par Boyuan Chen à l’Université Duke a créé un cadre révolutionnaire baptisé WildFusion, qui confère aux robots des capacités de perception proches de celles des humains pour naviguer dans des environnements extérieurs difficiles.

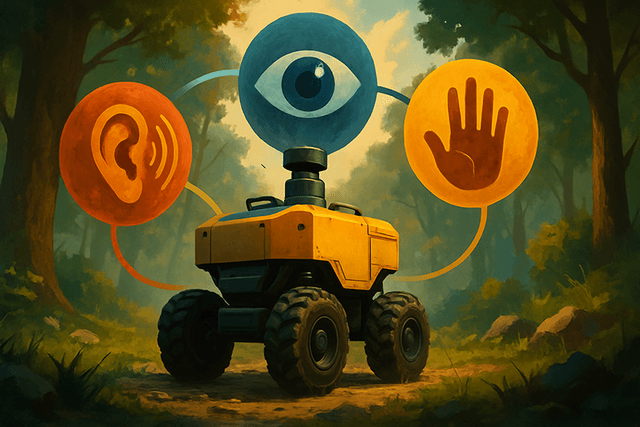

Contrairement aux robots classiques qui s’appuient uniquement sur les données visuelles issues de caméras ou de LiDAR, WildFusion équipe un robot quadrupède de sens supplémentaires : le toucher et la vibration. Cette approche multisensorielle permet au robot de construire des cartes environnementales plus riches et de prendre de meilleures décisions quant aux chemins sûrs à emprunter sur des terrains complexes.

« WildFusion ouvre un nouveau chapitre dans la navigation robotique et la cartographie 3D », explique Boyuan Chen, professeur assistant à l’Université Duke. « Il aide les robots à évoluer avec plus d’assurance dans des environnements non structurés et imprévisibles comme les forêts, les zones sinistrées ou les terrains accidentés. »

Le système fonctionne en intégrant les données de plusieurs capteurs. Des microphones de contact enregistrent les vibrations de chaque pas, permettant de distinguer des surfaces telles que des feuilles craquantes ou de la boue molle. Des capteurs tactiles mesurent la pression exercée par les pattes pour détecter la stabilité, tandis que des capteurs inertiels suivent l’équilibre du robot. Toutes ces informations sont traitées par des encodeurs neuronaux spécialisés et fusionnées en un modèle environnemental complet.

Au cœur de WildFusion se trouve une architecture d’apprentissage profond qui représente l’environnement comme un champ mathématique continu plutôt qu’une série de points déconnectés. Cela permet au robot de « combler les lacunes » lorsque les données des capteurs sont incomplètes, à l’image de la façon dont les humains naviguent intuitivement avec des informations partielles.

La technologie a été testée avec succès dans le parc d’État de la rivière Eno en Caroline du Nord, où le robot a parcouru avec assurance des forêts denses, des prairies et des chemins de gravier. « Ces tests en conditions réelles ont prouvé la remarquable capacité de WildFusion à prédire avec précision la franchissabilité des terrains », souligne Yanbaihui Liu, principal auteur étudiant.

À l’avenir, l’équipe prévoit d’intégrer des capteurs supplémentaires tels que des détecteurs thermiques et d’humidité pour renforcer encore la perception environnementale du robot. Grâce à sa conception modulaire, WildFusion offre de vastes perspectives d’applications au-delà des sentiers forestiers, notamment dans la gestion des catastrophes, la surveillance environnementale, l’agriculture ou l’inspection d’infrastructures isolées.