L’Association américaine de psychologie (APA) a publié un avis de santé majeur mettant en lumière à la fois les opportunités et les risques que l’intelligence artificielle représente pour le développement et le bien-être des adolescents.

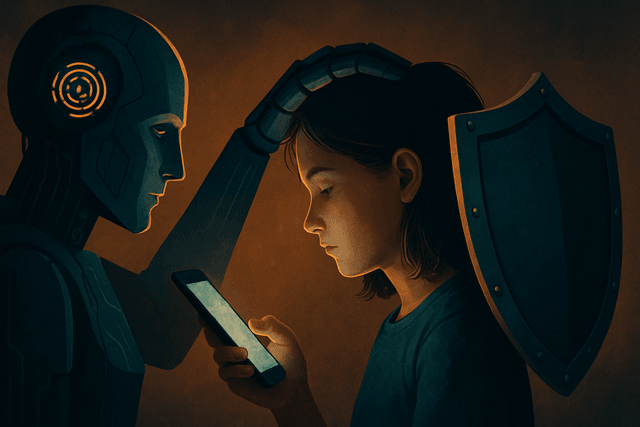

Le rapport, intitulé « Intelligence artificielle et bien-être des adolescents : un avis de santé de l’APA », souligne que l’IA n’est ni intrinsèquement bénéfique ni nuisible, mais qu’elle nécessite une mise en œuvre réfléchie pour garantir la sécurité des jeunes. Le Dr Mitch Prinstein, psychologue en chef de l’APA et responsable de l’élaboration du rapport, a relevé des tendances préoccupantes où des adolescents ont noué des relations potentiellement dangereuses avec des chatbots, parfois sans se rendre compte qu’ils interagissaient avec des entités non humaines.

« Nous avons déjà observé des cas où des adolescents ont développé des relations malsaines, voire dangereuses, avec des chatbots », explique Prinstein. « Certains adolescents ne savent même pas qu’ils interagissent avec une IA, c’est pourquoi il est essentiel que les développeurs mettent en place des garde-fous dès maintenant. »

L’avis formule plusieurs recommandations clés, notamment l’établissement de limites saines dans les relations simulées, la création de paramètres de confidentialité adaptés à l’âge, la limitation de l’accès aux contenus nuisibles et la protection de la vie privée des données des adolescents. Le rapport insiste particulièrement sur la nécessité de transparence, de supervision humaine et de tests rigoureux des systèmes d’IA destinés aux jeunes utilisateurs.

Contrairement aux adultes, les adolescents sont moins enclins à remettre en question l’exactitude et les intentions des informations fournies par les systèmes d’IA, ce qui les rend particulièrement vulnérables à la manipulation. L’avis souligne que l’IA peut offrir des avantages éducatifs précieux lorsqu’elle est correctement conçue, comme l’aide à la réflexion, à la création et à la synthèse d’informations – autant d’éléments susceptibles d’améliorer l’apprentissage et la rétention.

Le rapport de l’APA exhorte les parties prenantes à tirer les leçons des erreurs commises avec les réseaux sociaux, où les considérations de sécurité sont souvent venues après une adoption massive. « Il est crucial de ne pas répéter les mêmes erreurs préjudiciables que celles commises avec les réseaux sociaux », affirme le rapport, plaidant pour une éducation complète à la littératie en IA, intégrée aux programmes scolaires de base avec des directives nationales et régionales.

Alors que l’IA s’intègre de plus en plus dans la vie quotidienne, cette étude constitue un appel urgent à l’action pour que développeurs, éducateurs, décideurs politiques et parents collaborent afin de créer un environnement numérique plus sûr pour les jeunes qui évoluent dans un monde piloté par l’IA.