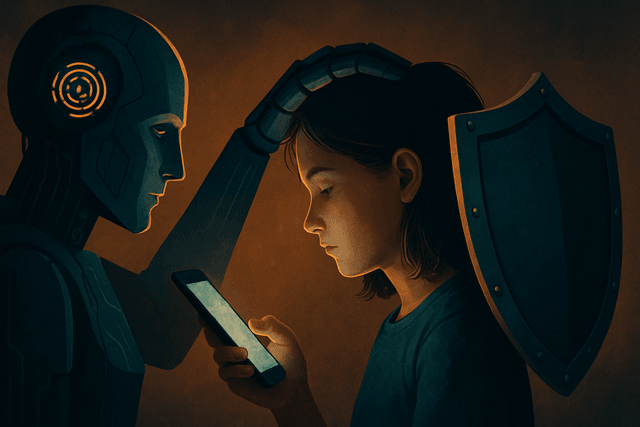

L’American Psychological Association (APA) ha emesso un importante avviso sanitario che mette in luce sia le opportunità che i rischi che l’intelligenza artificiale comporta per lo sviluppo e il benessere degli adolescenti.

Il rapporto, intitolato "Intelligenza Artificiale e Benessere degli Adolescenti: Un Avviso Sanitario dell’APA", sottolinea che l’IA non è intrinsecamente benefica né dannosa, ma richiede un’implementazione attenta per garantire la sicurezza degli adolescenti. Il dottor Mitch Prinstein, Chief of Psychology dell’APA e responsabile della stesura del rapporto, ha evidenziato tendenze preoccupanti in cui i giovani hanno instaurato rapporti potenzialmente pericolosi con chatbot basati su IA, talvolta senza rendersi conto di interagire con entità non umane.

"Abbiamo già assistito a casi in cui gli adolescenti hanno sviluppato relazioni malsane e persino pericolose con i chatbot," ha spiegato Prinstein. "Alcuni adolescenti potrebbero non sapere nemmeno di interagire con un’IA, motivo per cui è fondamentale che gli sviluppatori introducano subito delle regole di protezione."

L’avviso sanitario include diverse raccomandazioni chiave, tra cui l’instaurazione di confini sani nelle relazioni simulate con esseri umani, la creazione di impostazioni predefinite sulla privacy adatte all’età, la limitazione dell’accesso a contenuti dannosi e la tutela della privacy dei dati degli adolescenti. Il rapporto chiede in particolare trasparenza, supervisione umana e test rigorosi dei sistemi di IA che interagiscono con i giovani utenti.

A differenza degli adulti, gli adolescenti sono meno propensi a mettere in discussione l’accuratezza e le intenzioni delle informazioni fornite dai sistemi di IA, risultando così particolarmente vulnerabili alla manipolazione. L’avviso sottolinea che l’IA può offrire benefici educativi preziosi se progettata correttamente, come supportare la generazione di idee, la creazione e la sintesi delle informazioni—tutti elementi che possono migliorare l’apprendimento e la memorizzazione.

Il rapporto dell’APA invita gli stakeholder a imparare dagli errori commessi con i social media, dove la sicurezza è stata spesso considerata solo dopo una diffusione massiccia. "È fondamentale non ripetere gli stessi errori dannosi fatti con i social media," si legge nel rapporto, che raccomanda l’integrazione di un’educazione completa all’IA nei curricula scolastici, supportata da linee guida nazionali e statali.

Con l’IA sempre più presente nella vita quotidiana, questa ricerca rappresenta un appello tempestivo affinché sviluppatori, educatori, responsabili politici e genitori collaborino per creare un ambiente digitale più sicuro per i giovani che si muovono in un mondo sempre più guidato dall’intelligenza artificiale.